Der Superstar war wohl überrascht: Der Aufsichtsrat von Open AI hat Open AI-Gründer und Mastermind Sam Altman gefeuert. Man fühle sich zu wenig informiert, Altman habe Zielen Visionen und konkrete Entwicklungsschritte des Unternehmens nicht ausreichend klar und verständlich nach oben kommuniziert – so und ähnlich konnten Aussagen interpretiert werden, mit denen der Aufsichtsrat seine Entscheidung in den Stunden danach erklärte. Altman war kurz indigniert, heuerte wenige Stunden später bei Microsoft an und durfte sich noch einige Stunden später über eine Solidaritätserklärung von etwa 80% der Open AI-Belegschaft freuen, die nämlich ihrerseits den Aufsichtsrat zum Rücktritt aufforderte.

Noch weiß man nicht genau, was den Aufsichtsrat wirklich beschäftigt hat. Aus der Ferne betrachtet, und all die Visionen, Halluzinationen und düsteren Prophezeiungen rund um AI im Ohr, entsteht das Bild von Kontrollwünschen: Es geht um Macht im Unternehmen, über Wissen, Verfügungsmacht über Technologie, Entscheidungsgewalt über die Zukunft und den Wunsch, Menschen, Technik, Maschinen, Geld und die Zukunft gleichermaßen zu kontrollieren.

Dann geriet die Sache außer Kontrolle: Der Open AI-Aufsichtsrat knickte ein. Altman und andere, die teils aus Solidarität mit ihm, teils mit der Aussicht auf bessere Perspektiven, das Unternehmen verlassen hatten, kehrten in ihre Jobs zurück.

Über dem Durcheinander schweben große Fragezeichen: Was war hier los? Und vor allem: Was hat sich durchgesetzt? Businesserwartungen an ein Unternehmen? Die Macht einer weit verbreiteten erfolgreichen Technologie? Das technische Genie eines Einzelnen? Und was hätte durch den Machtkampf entschieden oder reguliert werden sollen?

In der Frühzeit der Science Fiction stellte Isaac Asimov die Robotergesetze in den Raum. Damals, 1942, zeichnete sich ab, dass autonome Maschinen eine Herausforderung werden könnten – aber die Idee, man würde das regeln können, war stärker. Roboter sollten Menschen nicht verletzen oder gefährden, sie sollten Menschen gehorchen, solange sie das nicht in Konflikt mit der ersten Regel bringt, und sie sollten sich selbst beschützen, solange sie das nicht in Konflikt mit den ersten beiden Regeln bringt.

Das waren die einfach gefassten ersten drei Robotergesetze. Später wurden sie durch ein Gesetz #0, das Gesetz #1 auf die gesamte Menschheit (vor einzelnen Menschen) ausdehnte, und ein Gesetz #4, das Robotern das Recht auf Selbstschutz einräumte, solange das nicht mit den vorherigen Gesetzen kollidierte, erweitert.

Asimov selbst misstraute manchen Maschinen so sehr, das er beispielsweise keine Flugzeuge bestieg. Ob Gesetze helfen könnten, solche Maschinenskepsis in den Griff zu bekommen?

Diskussionswürdig blieb im Licht der potenziellen Robotergesetzgebung immer die Frage, an wen sich Robotergesetze eigentlich richteten. An Roboter? Auf welcher Grundlage sollten diese sich an Gesetze von Fremden halten? An Menschen, die Maschinen maßregeln sollten? Wie? An Roboterentwickler? Also an Menschen, die Maschinen lehren wollten, selbstständig zu entscheiden?

Man möchte Technik kontrollieren, um zu kontrollieren, was mit Technik gemacht werden kann. Am liebsten möchte man auch Menschen kontrollieren, die Technik kontrollieren, um alles zu kontrollieren.

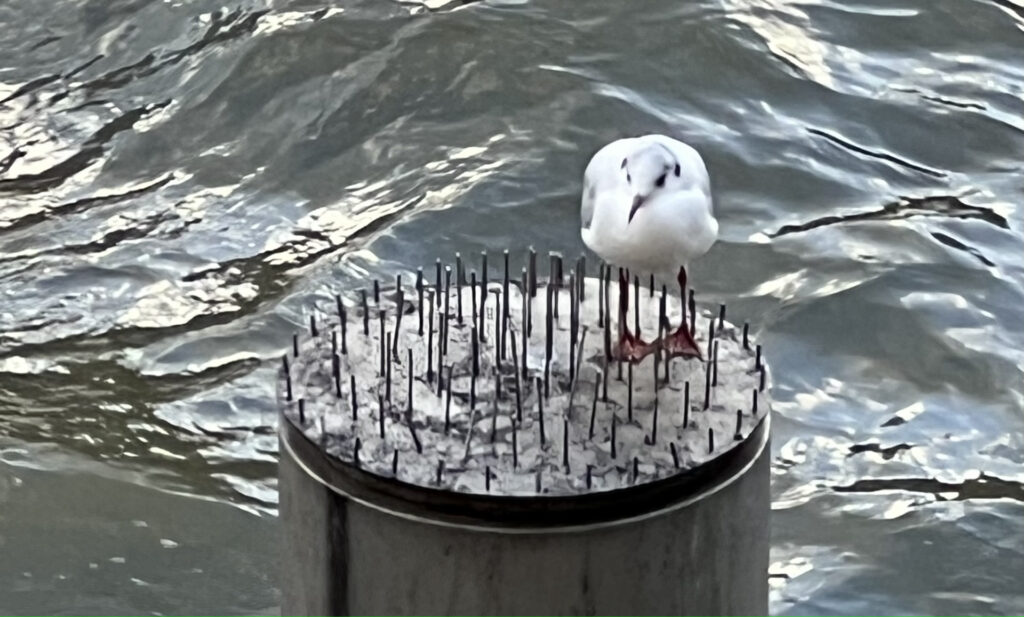

Bislang war das wenig erfolgreich. Entscheidungen wie die, Erfinder einer Technologie zu feuern, um mehr Kontrolle über die Entwicklung einer Technologie zu bekommen, sind ein neuer Versuch. Bei digitalen Technologien, die in der Produktion wenig ressourcenintensiv sind (im Betrieb dann schon) und mitunter leicht reproduziert werden können, ist die Kontrolle doppelt schwierig.

Was erwartet sich ein Aufsichtsrat, der eine weit fortgeschrittene und erfolgreiche Entwicklung kappt, sich selbst damit einiger Möglichkeiten beraubt und die freigesetzten Menschen an nichts hindern kann? Welche Kontrolle soll damit erreicht werden? Welche Argumente sind es, die dazu führen, diese Entscheidung innerhalb weniger Tage wieder über den Haufen zu werfen?

Welche Vorstellungen von Kontrolle über Technologie führen zu solchen Irrwegen?

TechnologiehysterikerInnen, die in den letzten Jahren in schneller Abfolge Social Network-, Daten- und KI-ExpertInnen wurden, argumentieren auf technologisch-deterministischen Perspektiven. Das bedeutet: Hier ist Technologie der bestimmende und schwer kontrollierbare Faktor. Technologie prägt Gesellschaft, Technologie setzt unausweichliche Prozesse in Gang. Der Mensch ist dabei Passagier. Was im Feld der Technologie geschieht, vollzieht sich mit Notwendigkeit.

Das ist die geeignete Kulisse von Visionen und Prophezeiungen, die oft hereinbrechende Mächte an die Wand malen, die „alles ändern“ werden, deren Auswirkungen man sich „noch gar nicht vorstellen“ kann, die Ungeahntes in Gang setzen werden. Verborgene technische Wirkmächte legitimieren Worthülsen, die in aller Austauschbarkeit vorrangig Aufregung erzeugen und Klarheit gar nicht anstreben.

Dem möchte man entgegenhalten: Technologie ist von Menschen gemacht. Technologie reflektiert soziale Ziele, Erwartungen und Bedürfnisse. Technologie ist beeinflussbar. – Das zeichnet noch nicht unbedingt ein freundlicheres Bild. Es bleibt offen, wessen Ziele und Erwartungen in die Entwicklung von Technologie fließen.

Müssten hier bereits Robotergesetze ansetzen?

Weder in einem technologisch deterministischen noch in einem sozial deterministischen Verständnis von Technik lassen sich klare Entwicklungslinien prognostizieren.

In der einen Perspektive möchte man lieber „die Technologie“ besitzen, in der anderen „die Menschen“.

In der einen Perspektive ist Technologie Kapital, in der anderen hat sie wenig intrinsischen Wert. Einmal herrscht der Glaube, eine Lösung gefunden zu haben, etwas vorläufig endgültig geregelt zu haben, einmal ist die führende Idee, alles wäre im Fluss. Einmal erinnert es an die Entführungen von Physiker und Atomwissenschaftler durch Sowjets, einmal daran, dass diese Entführungen nichts Nennenswertes hervorbrachten.

Die Open AI-Posse stellt einen Aufsichtsrat bloß, der glaubt, mit theoretischen und strategischen Prinzipien managen zu können. Das geht heute nicht mehr. Das sollte die eigentliche Essenz für Manager und Chefinnen sein, die meinen, vom Schreibtisch weg entscheiden zu können. Sie können verhindern und zerstören, im besten Fall das Verhindern verhindern. Aber sie können keine konkreten Ergebnisse herbeiführen. Das machen heute jene, die Technik verstehen und damit Dinge in Gang setzen können. Die anderen sind Passagier.

Das bedeutet auch – es wird Zeit für ein fünftes Robotergesetz: Du sollst den Roboter verstehen lernen. Sonst bleibt jede Diskussion über sozialen oder technischen Determinismus bloße Geräuschemacherei.