Plattformen sind jetzt selbst der Gegner, den man vor 30 Jahren beseitigen wollte: der übermächtige Mittelsmann. Das ist eine der Folgen des Prozesses, den Doctorow als Enshittification bezeichnet: Produkte werden schlechter. Sie bringen weniger Nutzen, sind dafür aber teurer, der volle Funktionsumfang kann nur über kostenpflichtige Zusatzabos aktiviert werden, Reparaturen sind entweder gar nicht vorgesehen oder zwingen in neue Premium-Abos.

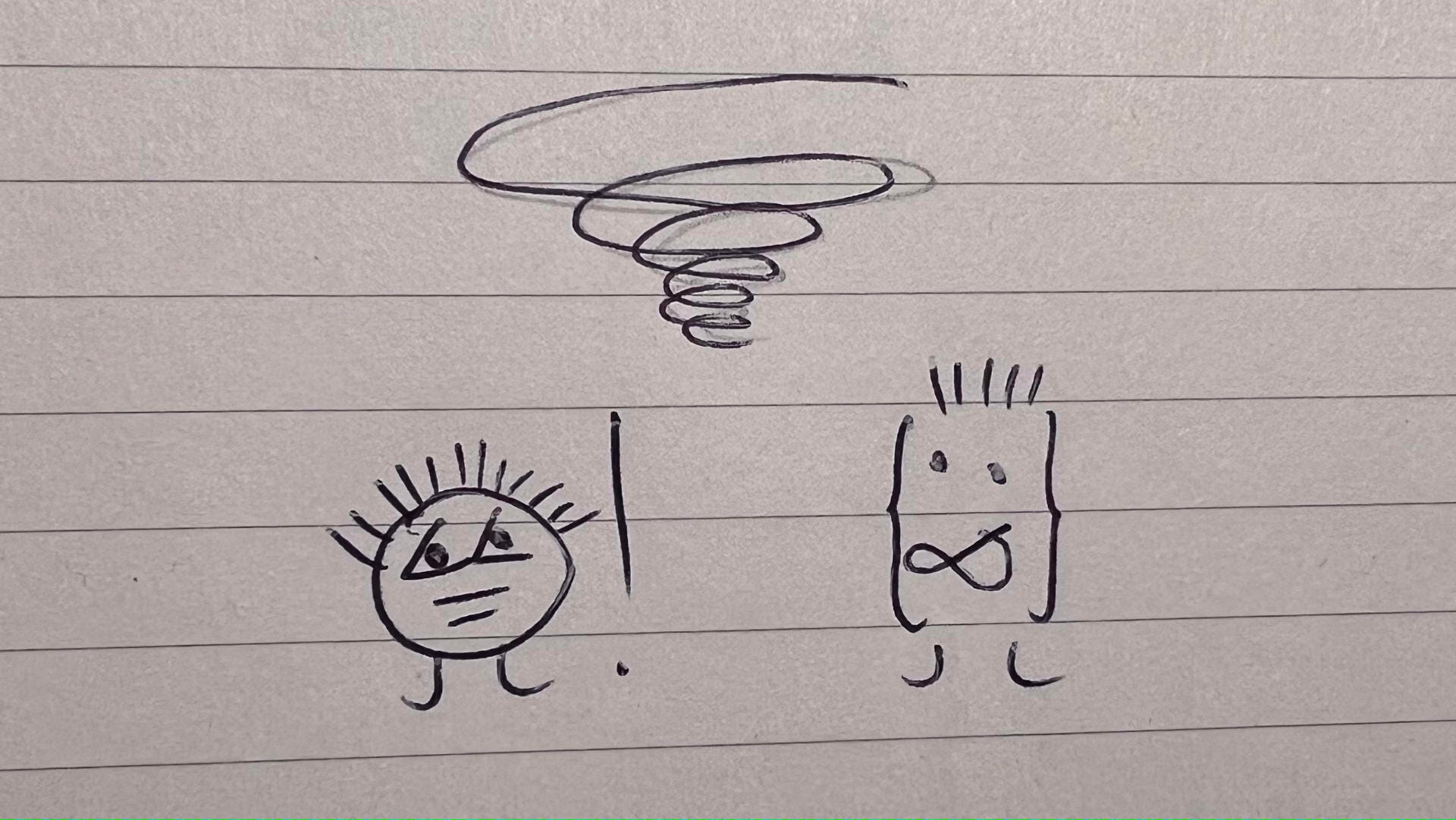

Doctorow beschreibt Enshittification als dreistufigen Prozess. In einer ersten Phase bieten Services ihren User Nutzen. Dieser Nutzen wird meist mit Kapital von Investoren finanziert. Eine Idee erzeugt Überfluss – der kommt Usern zugute. Ein Beispiel dafür ist die frühe Phase von Facebook: Neue Verbindungen waren nützlich, wiedergefundene Freunde ein echter Mehrwert und Nachrichten oder Veranstaltungskalender haben Neues ins Leben gebracht. In einer zweiten Phase kommt der Mehrwert Businesskunden zugute. Der Überfluss besteht jetzt nicht mehr nur aus Investorenkapital, sondern auch aus Reichweite und Kontakten und wird an Businesskunden verteilt. Am Beispiel von Facebook betrachtet war das die Phase, in der Werbeanzeigen tatsächlich gut abgestimmt werden konnten, günstig waren und zu treffsicherer Reichweite geführt haben.

In der dritten Phase fließt der ganze Nutzen nur noch dem Unternehmen selbst zu. Nutzungsbedingungen für User und Businesskunden verschlechtern sich, Preise steigen, User sehen Werbung anstelle der Posts ihrer Freunde, Unternehmen müssen einander bei Anzeigenpreisen überbieten, Anzeigenformate unterliegen immer strengeren Auflagen, Anzeigen bringen immer weniger.

Das Werk funktioniert, weil es wenig Alternativen gibt und weil die Umstiegs- oder Ausstiegskosten sehr hoch sind. Social Networks, Amazon, Google, Uber sind die gängigsten Beispiele für Enshittification-Prozesse.

Ein Verbündeter in der Argumentation ist Griechenlands Ex-Finanzminister Yannis Varoufakis mit seinem Konzept des Technofeudalismus. Technofeudalismus hat den Kapitalismus hinter sich gelassen. Kapitalisten, die Geld in die Hand nehmen, um Produktionsmittel zu kaufen und sich dann mit Produkten den Unbillen eines Marktes auszusetzen, sind arme Schlucker gegen Feudalherren, denen Grund und Boden gehört und denen egal sein kann, wer darauf welche Geschäfte macht, solange sie dadurch Renten beziehen. Digitaler Grund und Boden sind Plattformen, feudale Renten sind die Provision für Apple im App Store oder die immens hohen Royalties die Amazon von seinen Händlern bezieht. Die Profite jener, die auf Amazon oder im App Store gute Geschäfte machen, mögen hoch sein, aber sie sind prekär im Vergleich zu den bequemen und sicheren Einnahmen für Apple und Amazon.

Was machen wir mit diesen Diagnosen?

Für Doctorow sind Wettbewerb, Regulierung und Arbeitnehmerechte die Gegenmittel, die solche Entwicklungen lange Zeit verhindert haben, jetzt aber selbst gründlichen Erosionsprozessen unterliegen.

Wettbewerb ist den Winner Takes it All-Prinzipien der Digitalwirtschaft zum Opfer gefallen. Die Plätze sind vergeben, Macht- und Größenunterschiede sind zu groß, potenzielle Konkurrenz wird aufgekauft und integriert oder abgedreht. Die Konsequenz ist ein Absturz bei Innovation und Servicequalität, der ungestraft bleibt, weil Alternativen selten und ein Umstieg für User teuer ist.

Regulierung hat das Problem, mit der technischen Entwicklung Schritt zu halten und sich durchsetzen zu müssen. Außerdem müssten Politik und Behörden relevante Probleme erst erkennen und sich nicht von Plattformen mit Klagen über Innovationshürden und Wachtstumsbremsen einwickeln lassen. Digitalkonzerne beschäftigen Heere von Anwälten und Lobbyisten, die Aufzeichnungen des EU Lobbyregisters allein sprechen dazu Bände.

Eine letzte Hürde im Trend zur Verschlechterung von Digitalprodukten könnten Mitarbeiter sein: Während Tech-Arbeiter bis vor kurzem eine umhegte, gesuchte seltene Spezies waren, haben hunderttausende Kündigungen im Tech-Sektor allein in den USA in den letzten drei Jahren das Blatt gewendet. Programmierer, die theoretisch ihre Enshittifcation-Mitarbeit hätten verweigern können (auch wenn das etwas weit hergeholte Held der Arbeit-Mythologie ist), müssen heute froh sein, einen Job zu behalten.

Computer wurden als die flexibelsten Geräte überhaupt erfunden, die jeden Code laufen lassen können. Der Turing Automat kann jede codierbare Aufgabe lösen, das war der Sinn der Erfindung. Alle Einschränkungen sind also keine technischen Notwendigkeiten, sondern durch schlechte Regulierung, die schlechte Gesetze ermöglicht abgedeckt.

Doctorow ist bekennender Linksaktivist und spricht sich jetzt trotzdem für Wettbewerb und für Regulierung aus. Wenn es an konkrete Lösungen geht, wird die Suppe aber trotz aller blumigen Sprache recht dünn. Doctorow beschäftigt sich auf zwei von über 300 Seiten mit DMA und DSA und kritistiert sie als zu wenig weitreichend. Wo er einen Punkt hat: Regulierungen müssen sich entscheiden, ob sie Plattformen schwächen, also ihnen Möglichkeiten wegnehmen, sie Kontrollen unterwerfen wollen, oder ob sie sie stärken wollen, in dem sie ihnen neue Pflichten auferlegen, die mit neuen Rechten und Möglichkeiten einhergehen. Passendes Beispiel dazu sind einmal mehr Lösungen zur Altersverifikation: Jede Lösung, die von Plattformen entwickelt werden soll, ist schlecht weil sie diesen mehr Möglichkeiten einräumt und letztlich mehr Daten zukommen lässt. Akzeptabel sind klare Vorgaben, an die sich Plattformen richten müssen – wie etwa die Akzeptanz eines über eIDs erzeugten Alterstokens.

Doctorow ist auch kein Freund von Moderationspflichten; Belästigung und Hate Speech sind seiner Ansicht nach zu aufwendig in der Beweisführung, um gute Kriterien zu sein. Stattdessen schlägt er ein Bündel anderer Maßnahmen vor, die Plattformen so weit schwächen sollen, dass sie weder too big to fail noch too big to care sein können.

Eine erste Maßnahme wäre ein right to exit: Plattformen sollen zu offenen Protokollen verpflichtet werden, die es Usern ermöglichen, mitsamt ihren Daten von einem Netzwerk in ein anderes zu wechseln. Wem es auf Twitter zu tief wird, der soll mitsamt seinen Posts nach Mastodon wechseln und sich dort mit schon übersiedelten Freunden problemlos neu vernetzen können. Das soll Plattformen Relevanz nehmen, ist in der Praxis aber ein schwacher Trost. Denn auf Mastodon ist man nach wie vor recht einsam.

Eine zweite Verpflichtung fasst Doctorow als end to end-Prinzip zusammen. Plattformen sollen insofern in ihrer Mediationsrolle geschwächt werden, als beispielsweise Spotify verpflichtet werden soll, akkurate Suchergebnisse zu liefern – nicht ähnlich klingende Treffer aus für Spotify profitableren lizenzfreien AI-Playlists. Amazon soll ebenfalls angehalten werden, Suchtreffer zu liefern statt Kaufempfehlungen für ähnliches aus Eigenproduktion oder verkauften Suchergebnissen. Klingt gut, hat allerdings ähnliche Schwächen wie sie Doctorow an Moderationspflichten kritisiert: Die Qualität von Suchergebnissen ist schwer nachzuweisen; aus der Frühzeit der Suchmaschinen wissen wir, wie leicht Beschreibungen und Metatexte falsche Priorisierungen erzeugen können. Außerdem bleibt die Frage offen, mit welchem Recht verkaufte Suchergebnisse unterbunden werden sollen.

Ein dritter Punkt ist eine Verpflichtung zur Interoperabilität, der über das right to exit hinausgeht und Datenaustausch auf allen Ebenen ermöglichen soll. Auch das Recht auf Reparatur und den Einbau von Ersatzteilen kann als Interoperabilität gesehen werden. Hier ist die (von Doctorow nicht erwähnte) EU-Gesetzgebung schon etwas weiter.

Der letzte Punkt schließlich besteht im Wiedererstarken von Gewerkschaften und in Anti-Kartellgesetzgebung. Mit stärkeren Arbeitnehmerrechten könnten sich Menschen in die Position bringen, selbst wieder mehr gegen schlechtere Produkte tun zu können, und besser exekutierte Auflagen für Mergers könnten das Entstehen digitaler Übermacht gleich an der Wurzel verhindern. Schließlich sei gerade auf diesen Gebieten die Gelegenheit günstig, die Karten neu zu mischen. Trumps Chaos-Politik habe in den USA so viel über den Haufen geworfen, dass die Karten neu gemischt werden könnten

Interoperabilität ist sicher eine der erstrebenswertesten Lösungen aus Doctorows Portfolio. Möglicherweise ist das sogar auch ein Punkt, in dem Europa den USA dann etwas voraus hat: Denn europäische eGovernment-Lösungen wie eIDs beispielsweise müssen in 28 Richtungen (zu allen 27 Mitgliedsstaaten und nach außen) interoperabel sein.

Wie Berners-Lee wünscht sich auch Doctorow ein neues Internet, das mehr wie das gute alte Internet ist. Aber kann Nostalgie ein Wegweiser für die Zukunft sein? Wir sind schließlich in aller Freiheit und Mündigkeit und mit den besten Voraussetzungen des guten alten Internet in die Situation geraten, in der wir jetzt feststecken. Was soll uns davon abhalten, diesen Weg noch einmal so zu gehen? Eines von Doctorows häufigsten Beispielen ist der Kampf der Druckerhersteller gegen billige Druckerpatronen. Natürlich ist es absurd, dass hier IP-Gesetzgebung herangezogen werden kann, um billigere Tinte zu verhindern (Chips in Druckern prüfen, ob Originalzubehör verwendet wird – diese Chips zu deaktivieren verletzt Urheber- und Bearbeitungsrechte an der Software auf diesen Chips) – aber für wieviele smartphoneverwendende Internetuser ist es überhaupt noch im weiteren Bewusstseinshorizont, dass man so etwas wie einen Drucker besitzen könnte? Auch das Recht auf Reparatur ist sinnvoll, vernünftig und begrüßenswert, aber gegenüber der Freude am Konsum ein Nischenprogramm für Nerds.

Ich verstehe die Konzentration auf technische und rechtliche Aspekte, das ist actionable, das sind Forderungen, die sich an Politik und Gesellschaft richten können. Ich bin aber noch etwas ratlos bei der Suche nach dem ausschlaggebenden Moment, der aus passiven Netzwerk- und Plattform-Konsumenten aktive, mündige Selfhelp-Ingenieure machen wird.